Nas últimas semanas, quase US$ 1 trilhão foi eliminado das ações de

software e serviços. A FactSet caiu de um pico de US$ 20 bilhões para menos de US$ 8 bilhões. A S&P Global perdeu 30% em poucas semanas. A Thomson Reuters viu quase metade de seu valor de mercado evaporar em um ano. O índice S&P 500 Software & Services, com 140 empresas, recuou 20% no ano.

Na semana passada, a Anthropic lançou plugins específicos por setor para o Claude’s Cowork, um agente de IA projetado especialmente para trabalhadores do conhecimento, capaz de conduzir de forma autônoma pesquisas complexas, análises e fluxos de documentos.

Wall Street chamou isso de pânico. Eu passei a última década construindo SaaS vertical. Primeiro na Doctrine, hoje a maior plataforma de informação jurídica da Europa (competindo com LexisNexis, Westlaw etc.), e depois na fintool, uma plataforma de research de ações com IA nos EUA que hoje compete com Bloomberg, FactSet e S&P Global.

Eu construí o tipo de software que os LLMs agora estão ameaçando. E agora estou construindo o tipo de software que está fazendo a ameaça. Estive dos dois lados dessa disrupção.

Aqui está o que vejo: os LLMs estão desmontando sistematicamente as

“barreiras defensivas” (moats) que tornavam o software vertical defensável. Mas não todas. O resultado é um redesenho do que torna o software vertical valioso — e do múltiplo que ele merece.

Neste artigo:

Software vertical é aquele desenvolvido para um setor específico. Bloomberg para finanças. LexisNexis para o setor jurídico. Epic para saúde. Procore para construção.Veeva para ciências da vida, etc.

Essas empresas compartilham uma característica definidora: cobram caro e os clientes raramente saem. A FactSet cobra mais de US$ 15 mil por usuário por ano. O terminal Bloomberg custa US$ 25 mil por licença. A LexisNexis cobra milhares de dólares por mês de escritórios de advocacia. E as taxas de retenção giram em torno de 95%.

Eu diria que existem dez barreiras defensivas distintas. Os LLMs estão atacando algumas delas, enquanto deixam outras intactas. Entender quais são quais é todo o jogo.

atacando algumas delas, enquanto deixam outras intactas. Entender quais são quais é todo o jogo.

Um usuário do Bloomberg Terminal passou anos aprendendo atalhos de teclado, códigos de função e padrões de navegação. GP, FLDS, GIP, FA, BQ. Nada disso é intuitivo. É uma linguagem. E, quando você se torna fluente nela, migrar para outra plataforma significa voltar a ser “analfabeto”. Já ouvi isso inúmeras vezes:

“Somos uma casa FactSet.”

“Somos um escritório Lexis.”

“Somos uma casa Bloomberg.”

Essas não são afirmações sobre qualidade de dados ou conjunto de funcionalidades. São afirmações sobre memória muscular de software. As pessoas passaram uma década aprendendo a usar aquela ferramenta. Esse investimento não é transferível.

Essa era a barreira defensiva mais subestimada. Profissionais do conhecimento pagam para não ter que reaprender um fluxo de trabalho que levaram anos para dominar. A interface É uma parte central da proposta de valor.

Eu vivi isso na Doctrine.Tínhamos uma equipe de designers e um pequeno exército de gerentes de sucesso do cliente cuja função era integrar advogados à nossa interface. Cada mudança de UI era um projeto: pesquisa com usuários, design sprints, rollouts cuidadosos, acompanhamento próximo.

Passávamos semanas redesenhando um filtro de busca facetada porque os advogados tinham criado memória muscular em torno do modelo anterior. A interface não era um recurso. Era o produto. E mantê-la era um dos nossos maiores centros de custo.

Na Fintool, não temos onboarding. Não temos CSMs ensinando as pessoas a navegar no produto. Nossos usuários digitam em inglês simples o que querem e recebem uma resposta. Não há interface para aprender, porque tudo é chat.Todo aquele centro de custo — designers, CSMs, gestão de mudança de UI — simplesmente não existe. A interface de chat absorveu toda essa estrutura.

Pense no que um analista financeiro faz hoje em um Bloomberg Terminal. Ele navega até a função de screening de ações. Define parâmetros usando sintaxe especializada. Exporta os resultados. Muda para o construtor de modelo de DCF. Insere premissas. Roda análise de sensibilidade. Exporta para o Excel. Monta uma apresentação. Cada etapa exige conhecimento da interface aprendida. Cada etapa reforça o custo de troca. Agora pense no que o mesmo analista faz com um agente baseado em LLM:

“Mostre todas as empresas de software com market cap acima de US$ 1 bilhão, P/L abaixo de 30 e crescimento de receita acima de 20% ano contra ano. Construa um modelo de DCF para as 5 principais. Rode análise de sensibilidade na taxa de desconto e no crescimento terminal.”

Três frases. Sem atalhos de teclado. Sem códigos de função. Sem navegação. O usuário nem sabe qual provedor de dados o LLM consultou. E não se importa.

Quando a interface é uma conversa em linguagem natural, anos de memória muscular se tornam inúteis. O custo de troca que justificava US$ 25 mil por licença ao ano se dissolve. Para muitas empresas de software vertical, a interface era a maior parte do valor. Os dados subjacentes eram licenciados, públicos ou semi-comoditizados. O que justificava o preço premium era o workflow construído sobre esses dados. Isso acabou.

Software vertical codifica como uma indústria realmente funciona. Uma plataforma de pesquisa jurídica não apenas armazena jurisprudência. Ela incorpora redes de citações, sinais de Shepardização, taxonomias de headnotes e a forma específica como um advogado constrói uma petição. Essa lógica de negócio levou anos para ser construída. Reflete milhares de conversas com especialistas do setor. Quando construí a Doctrine, a parte mais difícil não foi a tecnologia. Foi entender como os advogados realmente trabalham: como pesquisam jurisprudência, como redigem documentos, como estruturam uma estratégia processual do início ao julgamento. Codificar esse entendimento em software funcional foi uma grande parte do que tornava o software vertical valioso — e defensável.

Os LLMs transformam tudo isso em um arquivo markdown. Essa é a mudança mais subestimada — e, acredito, a mais devastadora no longo prazo.

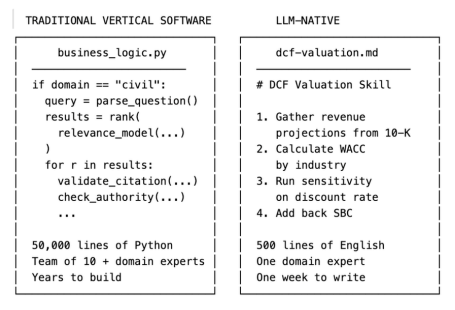

O software vertical tradicional codifica lógica de negócio em código. Milhares de ramificações “if/then” , regras de validação, checagens de compliance, fluxos de aprovação. Hardcoded por engenheiros ao longo de anos — e não quaisquer engenheiros. É preciso desenvolvedores que realmente entendam o domínio, o que é raro. Encontrar alguém que escreva código de produção e compreenda como funciona um fluxo de contencioso ou como estruturar corretamente um modelo de DCF é extremamente difícil. Modificar essa lógica exigia ciclos de desenvolvimento, QA e deploy.

Um exemplo concreto da minha experiência:

Na Doctrine, construímos um workflow de pesquisa jurídica que ajudava advogados a encontrar jurisprudência relevante para uma determinada questão. O sistema precisava entender o domínio jurídico (cível vs. penal vs. administrativo), decompor a pergunta em conceitos pesquisáveis, consultar múltiplos bancos de dados de tribunais, ranquear resultados por relevância e autoridade e apresentá-los com o contexto citacional adequado. Isso levou anos e uma equipe de engenheiros e especialistas jurídicos. A lógica de negócio estava espalhada por milhares de linhas de Python, algoritmos próprios de ranqueamento e modelos de relevância ajustados manualmente.

Cada modificação exigia sprints de engenharia, code review, testes e deploy. Na Fintool, temos uma habilidade de valuation por DCF. Ela ensina ao agente LLM como fazer uma análise de fluxo de caixa descontado: quais dados coletar, como calcular o WACC por setor, quais premissas validar, como rodar análise de sensibilidade, quando ajustar por stock-based compensation. É um arquivo markdown. Levaram uma semana para escrever. Atualizar leva minutos. Um gestor de portfólio que já fez 500 modelos de DCF pode codificar toda a sua metodologia sem escrever uma única linha de código.

Anos de engenharia versus uma semana escrevendo. Essa é a mudança.

E não é apenas velocidade. A skill em markdown é melhor em aspectos importantes. É legível por qualquer pessoa. É auditável. Pode ser customizada por usuário (nossos clientes escrevem suas próprias skills). E melhora automaticamente à medida que o modelo subjacente evolui — sem que precisemos alterar uma única linha de código.

A lógica de negócio está migrando de código escrito por engenheiros especializados para arquivos markdown que qualquer especialista do domínio pode escrever. A lógica acumulada que empresas de software vertical levaram uma década para construir agora pode ser replicada em semanas. A barreira baseada em workflow está se erodindo muito rápido.

Uma parte enorme da proposta de valor do software vertical era tornar dados difíceis de acessar fáceis de consultar. A FactSet torna filings da SEC pesquisáveis. A LexisNexis torna jurisprudência pesquisável. São serviços reais. Os filings da SEC são tecnicamente públicos, mas tente ler um 10-K de 200 páginas em HTML bruto. A estrutura varia entre empresas. A terminologia contábil é densa. Extrair os números certos exige interpretar tabelas aninhadas, seguir notas de rodapé e reconciliar números revisados. Antes dos LLMs, acessar esses dados exigia software especializado e grande infraestrutura de engenharia.

Empresas como a FactSet construíram milhares de parsers, um para cada tipo de documento e para as idiossincrasias de cada empresa. Exércitos de engenheiros mantinham esses parsers conforme os formatos mudavam. O código que transformava um filing bruto da SEC em dados consultáveis era uma vantagem competitiva real. Na Doctrine, também era assim. Construímos pipelines de NLP para diferentes tipos de decisões judiciais: reconhecimento de entidades nomeadas para extrair juízes, tribunais e conceitos jurídicos. Modelos dedicados de ML para classificar decisões por área do direito. Parsers customizados para cada tribunal, cada um com suas peculiaridades de formatação. Havia engenheiros que passaram anos construindo e mantendo essa infraestrutura. Era tecnologia impressionante — e uma barreira real, porque replicar aquilo significava anos de trabalho.

Na Fintool, não construímos nada disso. Zero NER. Zero parsers customizados. Zero classificadores específicos de indústria. Por quê? Porque os modelos de ponta já sabem navegar um 10-K. Sabem que o ticker da Home Depot é HD. Entendem a diferença entre receita GAAP e não-GAAP. Conseguem interpretar tabelas aninhadas sem que ensinemos o schema. A infraestrutura de parsing que levou anos para construir virou uma capacidade comoditizada que vem “de graça” com o modelo. Os LLMs tornam isso trivial.

Modelos de fronteira já sabem interpretar filings da SEC a partir de seu treinamento. Entendem a estrutura de um 10-K, onde encontrar políticas de reconhecimento de receita, como reconciliar números GAAP e não-GAAP.Você não precisa construir um parser. O modelo É o parser. Forneça um 10-K e ele responde qualquer pergunta sobre ele. Forneça todo o corpus de jurisprudência federal e ele encontra precedentes relevantes. O parsing, a estruturação e a consulta que o software vertical levou décadas para construir agora são capacidades comoditizadas embutidas nos próprios modelos fundacionais. Os dados não se tornaram inúteis. Mas a camada de “tornar pesquisável” — onde estava grande parte do valor e do poder de precificação — está colapsando.

Construir software vertical exige pessoas que entendam tanto o domínio quanto a tecnologia. Encontrar um engenheiro que escreva código de produção E compreenda como derivativos de crédito são estruturados é extremamente raro. Essa escassez criava uma barreira natural à entrada e limitava o número de concorrentes sérios em cada vertical. Os LLMs viram essa barreira de cabeça para baixo.

Na Doctrine, contratar era brutal. Não precisávamos apenas de bons engenheiros. Precisávamos de engenheiros que entendessem raciocínio jurídico: como funciona o precedente, como jurisdições interagem, quais são os fundamentos de um recurso a uma corte suprema. Essas pessoas quase não existiam. Então nós as formávamos.Toda semana havia palestras internas em que advogados ensinavam aos engenheiros como o sistema jurídico realmente funcionava. Levava meses até um novo engenheiro se tornar produtivo. A escassez de talento era uma barreira real — para nós e para qualquer concorrente. Na Fintool, não fazemos nada disso. Nossos especialistas de domínio (gestores e analistas) escrevem sua metodologia diretamente em arquivos markdown.

Não precisam aprender Python. Não precisam entender APIs. Escrevem em inglês simples como deve ser uma boa análise de DCF, e o LLM executa. A engenharia é tratada pelo modelo. A expertise de domínio — que sempre foi o recurso mais abundante — agora pode virar software diretamente, sem o gargalo da engenharia. Os LLMs tornam a engenharia trivialmente acessível, o que significa que o recurso antes escasso (transformar conhecimento em software) se torna abundante. É por isso que a barreira de entrada colapsa de forma tão dramática.

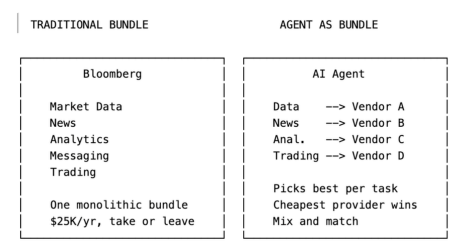

Empresas de software vertical crescem por meio de bundling de capacidades adjacentes. A Bloomberg começou com dados de mercado, depois adicionou messaging, notícias, analytics, trading e compliance. Cada novo módulo aumenta o custo de troca porque o cliente passa a depender do ecossistema inteiro, não apenas de um produto. A aquisição da IHS Markit por US$ 44 bilhões pela S&P Global foi exatamente essa estratégia. O bundle vira a barreira.

Na Doctrine, bundling era a estratégia de crescimento. Começamos com busca de jurisprudência, depois adicionamos legislação, notícias jurídicas, alertas, análise de documentos. Cada módulo tinha sua própria UI, onboarding e workflow. Construímos dashboards complexos para que advogados configurassem watchlists, criassem alertas automáticos por tema jurídico, organizassem pastas de pesquisa. Cada funcionalidade significava mais design, mais engenharia, mais superfície de interface. O bundle mantinha clientes presos porque todo o workflow deles estava dentro do nosso ecossistema.

Agentes baseados em LLM quebram essa barreira porque o agente É o bundle. Na Fintool, alertas são um prompt.Watchlists são um prompt. Screening de portfólio é um prompt. Não há módulo separado para cada função. Não há UI para manter. Um cliente diz:“Me avise quando qualquer empresa do meu portfólio mencionar risco tarifário em uma earnings call” — e simplesmente funciona. O agente orquestra dez ferramentas especializadas dentro de um único workflow. Pode puxar dados de mercado de uma fonte, notícias de outra, rodar análises em uma terceira e compilar o resultado. O usuário não sabe — e não se importa — que cinco serviços diferentes foram consultados.

Quando a camada de integração sai do fornecedor de software e passa para o agente de IA, o incentivo para comprar um bundle evapora. Por que pagar o prêmio da Bloomberg pelo pacote completo se um agente pode escolher, para cada funcionalidade, o melhor (ou mais barato) fornecedor? Isso não significa que o bundling morre da noite para o dia. A complexidade operacional de gerenciar dez fornecedores em vez de um é real. Mas a direção é clara: agentes tornam o unbundling viável de formas que antes não eram.

Algumas empresas de software vertical possuem ou licenciam dados que simplesmente não existem em outro lugar. A Bloomberg coleta dados de precificação em tempo real de mesas de trading no mundo todo. A S&P Global detém ratings de crédito e analytics proprietários. A Dun & Bradstreet mantém arquivos de crédito empresarial de mais de 500 milhões de entidades. Esses dados foram acumulados ao longo de décadas, muitas vezes por meio de relações exclusivas. Não dá para raspar. Não dá para recriar.

Se o seu dado realmente não pode ser replicado, os LLMs o tornam mais valioso, não menos. Os dados proprietários de preços em tempo real da Bloomberg? Não podem ser raspados. Não podem ser sintetizados. Não podem ser licenciados de terceiros. Em um mundo de LLMs, tornam-se o insumo escasso de que todo agente precisa. O poder de precificação sobre dados proprietários pode até aumentar.

O mesmo vale para os ratings da S&P Global. Um rating não é apenas dado — é uma opinião respaldada por metodologia regulada e décadas de histórico de default. Um LLM não pode emitir um rating. A S&P pode.

O teste é simples: esse dado pode ser obtido, licenciado ou sintetizado por outro?

Se não, a barreira se mantém.

Se sim, você está em risco.

Na Doctrine, isso ficou claro cedo. Inicialmente, organizávamos jurisprudência pública com camadas de taxonomias, redes de citações e modelos de relevância. Mas dados públicos não bastavam. Há cerca de cinco anos, a empresa começou a construir uma biblioteca exclusiva: anotações jurídicas proprietárias, análises editoriais e comentários curados que não existem em outro lugar. Hoje, esse acervo é difícil de replicar — e se tornou o verdadeiro moat.

As empresas que sobrevivem a essa transição são as que migraram de “organizamos melhor dados públicos” para “possuímos dados que você não encontra em nenhum outro lugar”.

O que mudou é que a camada de inteligência antes exigia anos de engenharia. Agora é uma capacidade embutida no modelo. E até o acesso ao dado está sendo comoditizado. Protocolos como MCP (Model Context Protocol) transformam qualquer provedor de dados em plug-in. Quando seu dado está disponível como plugin do Claude, o prêmio por “tornar acessível” desaparece.

A ironia é que os LLMs aceleram a bifurcação:

Quem tem dados proprietários ganha ainda mais.

Quem não tem, perde quase tudo.

Se seu dado não é realmente único — se pode ser obtido, licenciado ou sintetizado — você corre risco de comoditização. O agente de IA passa a ser dono da relação com o cliente. Ele é a interface, a marca confiável, o produto pelo qual o usuário paga.Você vira fornecedor do agente, não mais fornecedor direto do cliente.

É a teoria da agregação acontecendo em tempo real: o agregador (o agente) captura a relação com o usuário e a margem, enquanto os fornecedores (provedores de dados) competem por preço para abastecer a plataforma. Se Bloomberg, FactSet e dezenas de outros oferecem dados semelhantes, o agente roteia para o mais barato. O poder de precificação evapora. As margens comprimem.Você vira insumo comoditizado no produto de outro.

Na saúde, o domínio da Epic não é apenas sobre qualidade de produto. É sobre conformidade com HIPAA, certificações da FDA e ciclos de implementação de 18 meses que hospitais enfrentam.Trocar um EHR é um projeto multimilionário que pode afetar diretamente a segurança do paciente. Em serviços financeiros, os requisitos regulatórios criam lock-ins semelhantes: trilhas de auditoria, relatórios regulatórios, políticas de retenção de dados — tudo embutido no software.

HIPAA não se importa com LLMs. Certificação da FDA não fica mais simples porque existe GPT-5. Exigências de SOX não mudam porque a Anthropic lançou um novo plugin. A dominância da Epic em EHR é, fundamentalmente, um moat regulatório. E isso não é diretamente afetado por LLMs.

Na verdade, regulações podem desacelerar a adoção de LLMs justamente nas verticais onde o lock-in é mais forte. Um hospital não pode substituir seu EHR por um agente LLM que não é certificado, não tem trilhas de auditoria adequadas e não foi validado para suporte clínico.

Alguns softwares verticais ficam mais valiosos quanto mais participantes da indústria os utilizam. O IB chat da Bloomberg é a camada de comunicação de facto em Wall Street. Se todos os seus contrapartes usam Bloomberg, você também precisa usar. Não por causa dos dados, mas por causa da rede. LLMs não quebram efeitos de rede. Se algo, podem torná-los ainda mais valiosos, pois o fluxo de informação vira contexto e sinal.

O mesmo vale para softwares verticais que funcionam como camada de comunicação:Veeva na indústria farmacêutica. Procore na construção. O valor está em quem está na plataforma — não na interface.

Alguns softwares verticais estão diretamente no fluxo do dinheiro: processamento de pagamentos para restaurantes, originação de crédito para bancos, processamento de sinistros para seguradoras. Quando você está embutido na transação, trocar significa interromper receita. Ninguém faz isso voluntariamente.

Se seu software processa pagamentos, origina empréstimos ou liquida operações, o LLM não o desintermedia. Pode até melhorar a interface, mas a infraestrutura (“rails”) continua essencial.

A camada transacional é infraestrutura — não interface.

Quando seu software é a fonte canônica da verdade para dados críticos, trocar não é apenas inconveniente — é arriscado. E se houver corrupção de dados? Perda de histórico? Quebra de trilha de auditoria?

Epic é sistema de registro para dados clínicos. Salesforce é sistema de registro para CRM. Essas empresas se beneficiam da assimetria entre o custo de ficar (taxas altas) e o custo de sair (risco operacional enorme). LLMs não ameaçam diretamente esse status hoje. Mas agentes estão silenciosamente construindo o próprio.

Agentes não apenas consultam sistemas existentes. Eles leem SharePoint, Outlook, Slack. Coletam dados do usuário. Criam memórias persistentes entre sessões. Registram contexto quando executam ações. Com o tempo, acumulam uma visão mais rica do trabalho do usuário do que qualquer sistema isolado.

A memória do agente começa a se tornar a nova fonte de verdade — não porque alguém planejou, mas porque o agente é a única camada que vê tudo. Isso não acontece da noite para o dia. Mas, direcionalmente, agentes estão construindo seu próprio “sistema de registro”. E, à medida que essa memória contextual cresce, o moat tradicional enfraquece.

Somando tudo: cinco barreiras destruídas ou enfraquecidas. Cinco que permanecem. Mas as que quebram eram as que mantinham concorrentes fora. As que sobrevivem são as que apenas alguns incumbentes possuem.

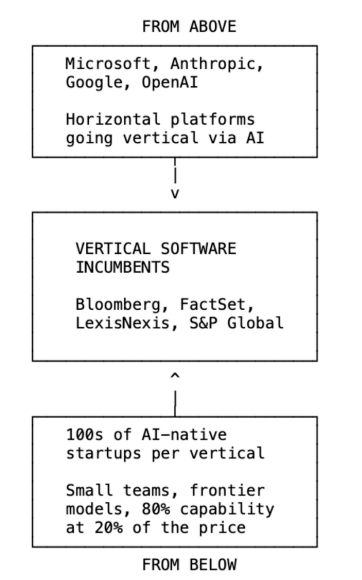

Antes dos LLMs, construir um concorrente crível para Bloomberg ou LexisNexis exigia centenas de engenheiros com expertise de domínio, anos de desenvolvimento, acordos massivos de licenciamento de dados, times de vendas enterprise e certificações regulatórias. Resultado: 2 ou 3 competidores sérios por vertical.

Depois dos LLMs, um time pequeno com APIs de modelos de ponta, expertise de domínio e bons pipelines de dados pode construir um produto que resolve 80% do problema em meses. Não porque tenha dados melhores. Mas porque o agente entrega respostas mais rápidas e intuitivas do que um terminal que exige anos de treinamento.

A competição não aumenta linearmente — explode combinatoriamente. Você não vai de 3 incumbentes para 4. Vai de 3 para 300. E é isso que destrói o poder de precificação. Antes, cada vertical tinha 2 ou 3 players dominantes cobrando preços premium porque as barreiras eram quase intransponíveis. Quando 50 startups AI-native oferecem 80% da capacidade por 20% do preço, a matemática muda completamente.

Aqui é onde acredito que o mercado está errando no timing — mesmo que esteja certo na direção.

Receita Enterprise Não Desaparece da Noite para o Dia

Os clientes da FactSet estão em contratos plurianuais. Os contratos do Bloomberg Terminal costumam ter duração mínima de dois anos. Esses contratos não evaporam porque a Anthropic lançou um plugin.

Ciclos de compras enterprise são medidos em trimestres e anos, não em dias. Um hedge fund de US$ 50 bilhões não vai substituir o S&P Global CapIQ amanhã porque o Claude consegue consultar filings da SEC. Eles vão avaliar alternativas por 12 a 18 meses. Rodar pilotos. Negociar termos contratuais. Esperar contratos vigentes expirarem.

O “precipício” de receita é real — mas é uma rampa, não um abismo. A receita atual está majoritariamente travada pelos próximos 12 a 24 meses. Mas aqui está o ponto que o mercado já entendeu: não é preciso a receita cair para a ação despencar. Basta o múltiplo comprimir.

Uma empresa de dados financeiros que negociava a 15x receita quando tinha poder de precificação e 95% de retenção pode passar a negociar a 6x receita quando o mercado acredita que ambos estão se deteriorando. A receita permanece estável. A ação cai 60%. É exatamente isso que está acontecendo com algumas empresas agora.

O mercado não está precificando um colapso imediato de receita. Está precificando o fim do múltiplo premium — porque os moats que o justificavam estão se dissolvendo.

A ameaça real não é o LLM em si. É um movimento de pinça que os incumbentes de software vertical não perceberam a tempo. De baixo, centenas de startups AI-native estão entrando em cada vertical.

Quando construir um produto crível de dados financeiros exigia 200 engenheiros e US$ 50 milhões em licenciamento de dados, o mercado naturalmente se consolidava em 3 ou 4 players. Quando exige 10 engenheiros e APIs de modelos de ponta, o mercado se fragmenta violentamente.

A competição deixa de ir de 3 para 4 — e passa de 3 para 300. De cima, plataformas horizontais estão, pela primeira vez, avançando profundamente em território vertical.

O Microsoft Copilot dentro do Excel agora faz modelagem de DCF com IA e parsing de demonstrações financeiras. O Copilot dentro do Word faz revisão contratual e pesquisa jurisprudencial. A ferramenta horizontal se torna vertical por meio da IA — não por meio de anos de engenharia especializada.

A Anthropic está fazendo o mesmo movimento pelo outro lado. E eu acompanho isso de perto porque a Fintool é investida da Anthropic.

O Claude está indo com tudo para o vertical. E o playbook é assustadoramente simples:

É isso. Esse é o stack completo necessário para transformar algo horizontal em vertical. Sem engenheiros especializados em cada domínio. Sem anos de desenvolvimento.

O software está se tornando headless. A interface desaparece.Tudo passa pelo agente.

O que importa não é mais o software em si. É possuir a relação com o cliente e os casos de uso — o que, na prática, significa possuir o agente. A mesma tecnologia que permite profundidade vertical (LLMs + skills + MCP) é a que finalmente permite que plataformas horizontais compitam em territórios que nunca conseguiram alcançar antes. E essa talvez seja a ameaça mais existencial para o software vertical: players horizontais B2B como a Microsoft não estão mais apenas “experimentando” vertical. Estão avançando agressivamente — porque agora é mais fácil do que nunca, e porque precisam dominar casos de uso e workflows para continuar relevantes em um mundo AI-first.

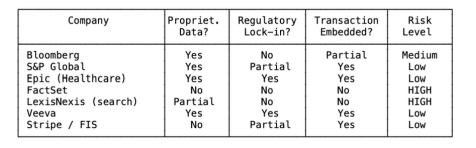

Um Framework para Avaliar Risco

Nem todo software vertical está igualmente exposto. Eis como eu penso sobre quais categorias sobrevivem e quais não.

Alto Risco: A Camada de Busca

Se o seu valor principal é tornar dados pesquisáveis e acessíveis por meio de uma interface especializada — e os dados subjacentes são públicos ou licenciáveis — você está em sérios problemas. Isso inclui:

Essas empresas negociavam a 15–20x receita por causa de lock-in de interface e competição limitada. Ambos estão evaporando. Pense nos provedores de dados financeiros que perderam 40–60% de market cap no último ano. O mercado está correto em reprecificá-los.

Risco Médio: Portfólio Híbrido

Muitas empresas verticais têm uma combinação de linhas defensáveis e expostas. Por exemplo:

As quedas de 20–30% nesse grupo refletem a incerteza do mercado sobre qual segmento realmente sustenta o valuation. A pergunta-chave: qual percentual da receita vem de moats que os LLMs não conseguem tocar?

Menor Risco: Fortalezas Regulatórias

Se o seu moat é certificação regulatória, infraestrutura de compliance e integração profunda com workflows mission-critical, os LLMs são pouco relevantes no médio prazo. Exemplos:

Essas empresas podem até se beneficiar da disrupção em outras áreas, à medida que clientes consolidam fornecedores confiáveis para fluxos regulados, enquanto trocam ferramentas usadas apenas para recuperação de informação.

O Teste

Para qualquer empresa de software vertical, faça três perguntas:

4.Existe lock-in regulatório?

7.O software está embutido na transação?

A conclusão não é que “todo software vertical está morto”. É que o valor está migrando. Da interface para o agente. Do workflow codificado para a skill em linguagem natural. Da organização de dados públicos para a posse de dados proprietários. Do bundle fechado para a orquestração inteligente. E essa migração não é opcional. É estrutural.

Quando comecei a construir a Doctrine, em 2016, um dos principais moats era a interface. Criamos experiências de busca elegantes sobre jurisprudência e legislação. Advogados adoravam porque era mais rápido e intuitivo do que qualquer coisa no mercado. A maior parte dos dados era pública — mas nossa interface e nosso motor de busca tornavam tudo acessível.

Se eu estivesse começando a Doctrine hoje do zero, enfrentaria um cenário competitivo fundamentalmente diferente. Um agente baseado em LLM consegue consultar jurisprudência com a mesma eficácia que nossa interface conseguia. Esse é o ponto central.

O “acerto de contas” do SaaS vertical não significa que todo software vertical vai morrer. Significa que o mercado finalmente está distinguindo entre empresas que realmente possuem algo escasso — e aquelas cujo valor estava concentrado em camadas que agentes de IA conseguem replicar. Não é o fim do vertical. É o fim de certos tipos de moats:

O que permanece — e possivelmente se fortalece — são:

A mudança não é tecnológica apenas. É estrutural. O valor está migrando da ferramenta para o orquestrador. Da UI para o agente. Do software como produto para o software como camada invisível. E quem entender isso cedo o suficiente não apenas sobrevive — redefine a categoria.

Por: Nicolas Bustamante